TABLE DES MATIÈRES

1. Introduction.................................................................................... 2

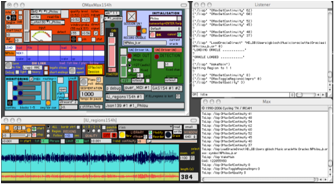

2."Jabalion"

Implémentation sur SuperCollider 3.................................... 8

2.1.

SuperCollider................................................................................ 8

2.2. Synthétiseurs

et moteurs de Synthèse......................................... 12

2.2.1. Entrées Analogiques....................................................................................... 12

2.2.2. Lecture de fichiers

sons................................................................................... 14

2.2.3. Synthèse.......................................................................................................... 15

2.2.3.1. Modulation de

Fréquence............................................................................ 15

2.2.3.2. Gendy........................................................................................................... 17

2.2.3.3. k-means........................................................................................................ 19

2.3. Traitements

du Signal.................................................................. 20

2.3.1 Modulations....................................................................................................... 21

2.3.2 Lignes à retard................................................................................................... 23

2.3.2.1 Réverbération................................................................................................ 24

2.3.2.2 Retards Longs et

Structures Rythmiques................................................... 26

2.3.2.3 Modulation du temps

de retard.................................................................... 29

2.3.3 Analyse de Fourier............................................................................................ 32

2.3.3.1 Conformal Map.............................................................................................. 35

2.3.3.2 Freezer............................................................................................................ 37

2.3.4. Granulation........................................................................................................ 39

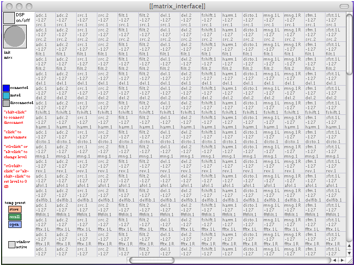

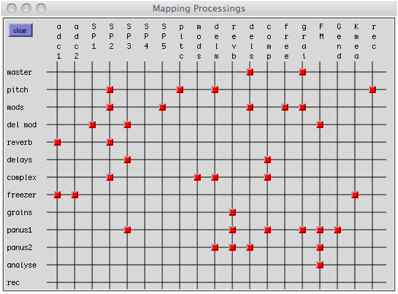

2.4 Matrix et Audio Mappings.............................................................. 44

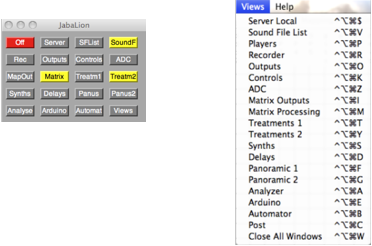

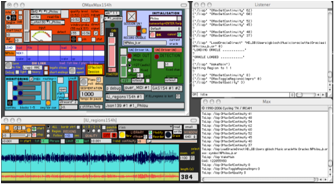

2.5 GU Interface

Graphique................................................................. 53

2.5.1. Potentiomètres et indicateurs de niveau........................................................ 57

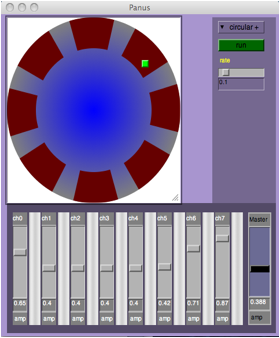

2.5.2 Panoramique...................................................................................................... 61

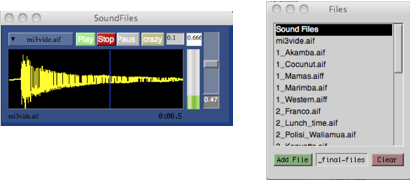

2.5.3 Lecteur de Fichiers............................................................................................ 64

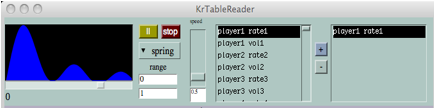

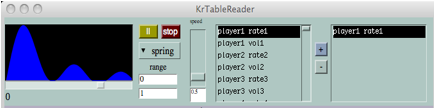

2.5.4 Lecteur de tables.............................................................................................. 66

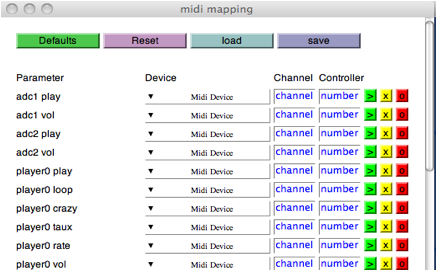

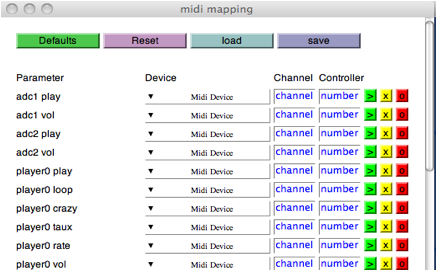

2.5.5 Tableau MIDI..................................................................................................... 68

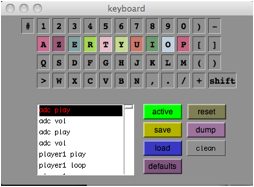

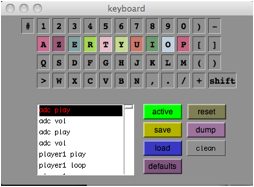

2.5.6 Clavier de

l’ordinateur....................................................................................... 69

2.6. Contrôle..................................................................................... 70

2.6.1 L’interface ordinateur......................................................................................... 72

2.6.2 L’Interface MIDI................................................................................................. 74

2.6.3. Arduino, captation

du geste............................................................................ 76

2.6.4. Le son contrôleur.............................................................................................. 80

2.6.5. Sauvegarde et enregistrement....................................................................... 84

3.

"Transgressions" Implémentation sur MAXMSP 5............................. 86

3.1.

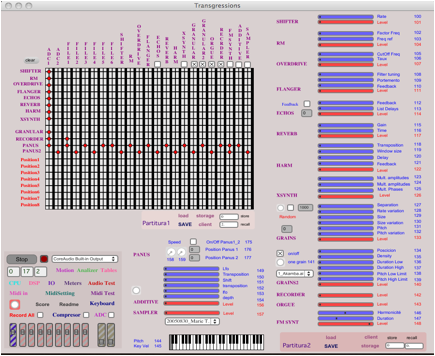

Présentation de la version MAXMSP 5............................................................... 87

3.2.

Comparaison avec Jabalion.................................................................................. 93

4. Annexes ....................................................................................... 96

4.1."Border

Border Expres" Olarte / Okach, Electronique et Danse.......................... 96

4.2."Coco

duro" Olarte / Montes de Oca Torres, Guitare et électronique................. 96

4.3."Workshop

Helsinki Meeting Point"/ Sibelius Academy Finlande...................... 96

5. Conclusions.................................................................................. 97

6. Bibliographie.................................................................................. 98

1. Introduction

Dans ce travail je

vais explorer, présenter et discuter un environnement logiciel construit sur

SuperCollider 3 et MaxMSP 5, pour l'improvisation de la musique électroacoustique.

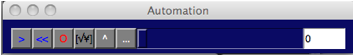

Je vais aborder la

problématique de l'instrument ou l'interface musicale pour piloter le logiciel :

l’interface graphique, les contrôleurs MIDI, l’analyse du son, la lecture de

courbes et de tables, les automatisations.

Pourquoi un environnement informatique?

En tant que

musicien et expérimentateur j’ai toujours été à la quête des outils électroacoustiques,

plus pour les performances publiques que pour la production en studio, ainsi

j’ai été confronté aux synthétiseurs, analogiques et numériques. J’ai perçu le

double enjeu de ces outils : la production sonore et le geste contrôleur,

car ces machines à sons semblent séparer le problème technique de la synthèse

avec des oscillateurs, filtres, amplificateurs de celui de l’interprétation

instrumentale présenté sous forme de claviers, potentiomètres, boutons,

tableaux de connectiques (patchs). J’ai donc avancé parallèlement dans ces deux

directions en apprenant les théories et les techniques des traitements et

synthèses sonores puis en expérimentant avec le concept d’interface.

Comme Claude

Risset le rappelle,

l'ordinateur n'est pas en lui même un instrument de musique, il est une grande

machine à calculs avec une interface visuelle et un accès gestuel très limité :

un clavier et une souris. Cependant, comme on peut le constater dans manifestations

comme le live coding et les laptop orchestra, l'ordinateur

cherche à faire repenser sa place dans l'organologie contemporaine.

J’ai abandonné progressivement

l’illusion d’une conception d’un instrument nouveau principalement à cause de

l’isolement dans un répertoire musical et gestuel inexistant. J’ai donc décidé

« d’augmenter » mon instrument : la guitare avec des capteurs,

et de là j’ai voulu avoir aussi des actionnaires pour modifier le comportement

acoustique de la surface vibrante, imposer d’autres modes de vibration, exploiter

les réalimentations acoustiques, enfin passer de l’interface de contrôle à

l’interface contrôlée.

Ces idées m’ont

poussé dans l’étude des automates et de robots et notamment du disklavier, mais

ma place comme musicien se voyait métamorphosée en quelque chose de plus proche

de la sculpture sonore ou des arts plastiques.

Toujours actif

dans ma discipline d’instrumentiste, je suis revenu sur mon instrument et j’ai

décidé d’approfondir le côté logiciel et environnement informatique. Pour ceci,

je me suis proposé d’apprendre un outil très réputé comme SuperCollider et d’y

bâtir l’environnement dont je ressentais le besoin.

Il me fallait une plate-forme

de pilotage pour interconnecter les traitements sonores appliqués à des sources

acoustiques, la gestion de fichiers sons, différentes techniques de synthèse

avec des paradigmes de contrôle comme capteurs, interfaces MIDI, microphones,

clavier, souris et caméra de l’ordinateur. Le tout étant d’un accès simple pour

être performant dans des circonstances musicales individuelles et collectives.

Bien que plusieurs

logiciels circulent dans le milieu d’informatique musicale comme Omax,

IXIQuarks, NajoInterface parmi d’autres commercialisés dans le monde de DJs

comme Pacemaker, Kontact, Traktor et les produits de Native Instruments pour ne nommer que quelques uns, j’ai toujours

été convaincu de l’importance du processus pédagogique dans la réalisation de

son propre logiciel, donc j’ai écrit mon propre environnement Jabalion.

Cet écrit peut

ressembler à un manuel du logiciel, j’en suis conscient mais je me sens obligé

de rendre compte du processus d’écriture, de conception, de construction et de

mise en marche du logiciel. D’autant plus que les sources francophones académiques

concernant SuperCollider sont encore très rares.

Quelles sont les caractéristiques de cet outil informatique?

Ecrire cet

environnement permettant le couplage entre l'ordinateur, les sources

acoustiques et les interfaces de contrôle, exige une planification où les

perspectives et les attentes de fonctionnement sont prévues clairement depuis

le départ.

Une première

question concerne l'interactivité. Deux chemins se présentent comme choix très

différents. Je vais les illustrer avec le travail de deux musiciens, le premier

: George Lewis tromboniste, improvisateur membre du AACM à Chicago (Association for the Advancement of Creative

Musicians) qui a consacré une partie très importante de sa recherche au développement

du logiciel « voyageur » fondé sur le paradigme de « machine

listening » où l'ordinateur reçoit des informations sur le jeu du

musicien et propose des réponses sonores incluant une certaine logique musicale.

Ce qui m'intéresse

dans sa démarche, c’est le degré d'autonomie de l'ordinateur, car comme

l'explique Lewis lui même :

« ... je

n'aime pas jouer des concerts en trombone solo, je préfère jouer avec quelqu'un

d'autre, je cherche à faire un logiciel pour comprendre quelles sont les choses

qu'un improvisateur doit connaître pour réussir à improviser avec un autre

musicien... »

Il cherche donc à avoir

un outil qui possède en amont un ensemble de modèles de comportement pour

produire une réponse musicale au jeu (la machine connaît ou reconnaît la

musique!). En d'autres mots, une fois le logiciel démarré, il doit agir comme

un deuxième musicien qui écoute, agit et propose. C'est aussi l'inquiétude de

Gerard Assayag et son groupe de

recherche autour du logiciel « Omax » sur lequel je reviendrai plus

loin, qui combine la puissance d'analyse de Lisp avec le traitement de signal

en Max.

En face de cette « autonomie »,

nous avons le cas d'un logiciel où le contrôle de ses opérations est totalement

déterminé par les commandes en temps réel du musicien. C'est le cas dans les « IXIQuarks »

(une série de modules interconnectés par busses de contrôle et de signaux) où

la machine répond pas à pas aux informations données par l’interprète. C’est à

dire pas de commande ou de geste modificateur donc pas de réponse sonore.

Bien que dans les

deux cas on cherche à faire de la musique avec la machine, qui

« attend » le déclenchement du musicien, le degré d'intelligence de

la machine ou la capacité à prendre des décisions, ou encore à les apprendre,

permet d'éclaircir et comprendre la différence profonde de ces deux

perspectives. Dans la première, la machine est en quelque sorte maître-esclave

d’elle même, dans la deuxième la machine est « l'esclave » suivant

les ordres du « maître » musicien interprète.

Jouer avec l'ordinateur

qui « agit » permet une indépendance dans le jeu, par exemple, je

joue une note : les opérations faites sur cette note suivent des

algorithmes écrits à l'avance, dont je pourrais prédire le résultat, mais si je

joue spontanément une combinaison plus complexe de notes, je ne peux pas être

complètement sûr de la proposition résultante mais je peux la connaître à peu

près, donc un facteur surprise ou inconnu peut jouer un rôle déterminant.

Dans l'ordinateur

qui « obéit », le musicien joue une note puis commande au logiciel

les traitements qui vont suivre à chaque événement. Ceci demande au musicien d'être

concentré à la fois dans la partie instrumentale et dans les opérations logicielles.

L’utilisation de

ces logiciels n’est pas aussi dichotomique qu’elle semble l’être, et des solutions intermédiaires sont

possibles, grâce à des automatisations qui rendent les tâches, et la quantité

d'informations plus légère.

Par exemple : je

joue ma note et je déclenche un ensemble de courbes qui vont contrôler les

paramètres d’un filtre jusqu'à ce que l’on décide de l'arrêter. Ceci demande

une longue tâche de calibrage mapping

et de sauvegarde de configurations en presets. D’autre part il est évident

que dans le logiciel de Lewis, il serait très compliqué, voir impossible, d'établir

de nouvelles lois de comportement au cours du jeu.

Une autre

possibilité est de rendre le contrôle de la partie logicielle à un autre

musicien, ceci permet de pouvoir se concentrer profondément dans le jeu et le

langage, et d'être dans une situation plus proche de la musique de chambre.

Je vais donc

exclusivement traiter du cas de l’ordinateur contrôlé, d’où l'absence dans les programmes que je présente

pour ce mémoire, d'algorithmes d'apprentissage ou du type oracle ou prédictions

statistiques ou encore des prises autonomes de décisions. Je me suis concentré à

faire un mapping ouvert de chaque paramètre de contrôle, pour pouvoir

les piloter de différentes façons : avec un contrôleur MIDI, ou un ensemble des

capteurs, ou des courbes estoquées dans des tables ou dessinées à la main, ou

avec les données issues d'une analyse spectrale.

D’autres

caractéristiques bien qu’évidentes doivent être prises en compte, par

exemple : une interface graphique simple et claire, un contrôle précis des

dynamiques, de positions ou trajectoires spatiales, possibilité d’enregistrer

et automatiser pour jouer avec la forme et la mémoire, possibilités de

développer, varier ou contraster les matériaux musicaux.

Pourquoi « pour l'improvisation »?

L'improvisation

musicale est un sujet très intéressant et délicat à traiter, car il s'agit

d'une discipline hautement subjective et dont la définition est dépendante de

la pratique de chaque artiste. De plus, le contexte dans lequel il joue - par

exemple l’improvisation très présente dans la musique de l’Inde - s’éloigne

dans les méthodes, les principes, l’usage et même dans les buts de

l’improvisation dite « libre » pratiquée dans plusieurs pays

européens.

Sujet mystique à

caractère religieux pour certains, ou activité ludique et pédagogique pour

d'autres, ou comme Georges Lewis aime bien le dire « une façon de

vivre » ;

en tant que musiciens nous avons tous été concernés en différentes

circonstances et à des échelles différentes par cette discipline.

Une dualité

souvent évoquée est celle du couple « improvisation vs composition ».

On parle de composition instantanée ou de création spontanée, mais la frontière

commence à apparaître quand on considère une improvisation comme une œuvre

achevée en elle même ou comme un processus précompositionnel qu'il faut

travailler, répéter et modeler par l'écriture.

Du côté auditeur,

cette opposition n’est toujours pas évidente car certaines improvisations

sonnent comme des compositions largement travaillées (synchronisation rythmique,

formes nettes...) et à son tour une écriture très ouverte (les scores

graphiques...) donne comme résultat des interprétations tellement différentes

de la même pièce qu'on a le sentiment d'une musique qui s’invente à chaque fois

donc improvisée.

Le point de

rencontre entre ces deux mondes (écriture, improvisation) est la recherche

esthétique du concept d’œuvre ouverte, (d’indétermination ou de liberté

formelle, interprétative) en

parlant de l’opposition d’une poétique de la multiplicité du sens, contre une théorie des formes finies ou

fermées. Umberto Eco souligne d’ailleurs à ce sujet:

« Cette

poétique de l’univoque et du nécessaire recouvre un monde ordonné, une

hiérarchie des êtres et des lois qu’un même discours poétique peut éclairer à

plusieurs niveaux mais que chacun doit entendre dans la seule perspective

possible, qui est celle du logos créateur. L’ordre de l’œuvre d’art se confond

avec celui d’une société impériale et théocratique ; les lois qui président

à la lecture sont celles-là même d’un gouvernement autoritaire qui guide

l’homme dans chacun de ses actes en lui prescrivant les buts à atteindre et en

lui offrant les moyens d’y parvenir »

Un des traits

distinctifs de l'improvisation sera donc son éloignement de l'écriture, non pas

radicalement - comme Barb Phillips qui a déclaré lors d'une « master class »

au conservatoire de Paris, avoir décidé de ne plus jouer une partition depuis plus

de 40 ans-

mais dans une progression à plusieurs degrés : c'est à dire que plus on

perd de contrôle sur le papier en effaçant des paramètres, plus on est dans le

monde de l'improvisation.

Par exemple, si on

n'écrit pas la dynamique, ou si on utilise des boîtes aléatoires avec des

hauteurs mais pas des rythmes ou le contraire, ou si on ne précise pas les

durées des sections ou l'ordre d'enchaînement, si on n’écrit qu'une suite

d'accords ou voire seulement quelques indications poétiques, ou voire des indications

graphiques, l'interprétation devient un exercice de composition.

Ce rapport à

l'écriture peut aussi se présenter sous un autre aspect : la minimisation du

temps de création et d'interprétation. Dans le contexte de musiques improvisées,

le temps de création est celui de l’interprétation : c’est à dire qu’ils

sont fusionnés, toutes les opérations musicales sont faites en temps réel. Nous

avons d'autres contraintes différentes à celles imposées pour le travail en

studio où en face du papier. Ce fameux « temps réel » basé dans la

puissance de calcul des processeurs a donné lieu à tout un développement hardware

et software pour résoudre les paradigmes de la musique mixte : captation,

traitement, diffusion, et pose des défis à l’esthétique musicale dans les concepts

fondamentaux comme celui de structure et forme, dans le vocabulaire sonore avec

l’exploration et le maniement du matériau sonore et l’idée « politique »

de création collective.

L'improvisation

est pour moi un outil de recherche à la fois esthétique et organologique mais

aussi une discipline d’écoute individuelle et collective, intérieure et

musicale, raisons pour lesquelles je lui ai consacré ce travail.

Le plan

Après une brève

introduction à la syntaxe de SuperCollider, je vais décrire et explorer

l'architecture de Jabalion, parcourant certaines techniques de synthèse, et de

traitement du signal, puis les outils pour organiser et acheminer les signaux

audio et contrôle. Je vais aussi étudier l'interface graphique, une composante

clé dans ce type de projets. En suite je vais comparer l’expérience de

réalisation d’un tel travail sur MaxMSP, les différences, les atouts et les

difficultés d’un langage du type objets graphiques, logique totalement

différente d’une programmation du type texte. Finalement j’accompagne ce

travail avec une série d’exemples tirés de ma pratique professionnelle.

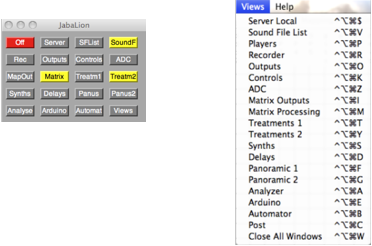

2."Jabalion" Implémentation sur SuperCollider 3

Dans les chapitres

que suivent, je vais présenter le logiciel Jabalion écrit dans SuperCollider. Pour

ceci, je commence en parlant de l’environnement logiciel puis je passe à une

description du code (le code en entier fait l’équivalent d’une cinquantaine de

pages), dont j’en ai extrait et commenté les parties les plus importantes, par

exemple les synthétiseurs, le contrôle et l’interface graphique.

Bien que toute

cette section peut paraître un peu austère et difficile à lire pour la syntaxe

du code, j’étais obligé d’y passer, autrement la partie la plus intéressante et

à laquelle j’ai dédié le plus d’énergie, la programmation et l’écriture

informatique, passerait sous l’ombre. Donc pour mettre en valeur l’objet de ce

mémoire, le travail de programmation, j’ai alterné la description des concepts

techniques et le code écrit pour chaque concept.

J’espère aussi que

cette présentation de mon approche dans l’écriture servira à ceux intéressés

dans ce type de langage. Les sources en langue française sont très rares pour

ce type de logiciel où l’anglais l’emporte comme langue principale tant dans

les forums de discussion d’utilisateurs que dans celui de développeurs, ainsi

que pour les tutoriaux, livres et documents référentiels. Donc ce mémoire peut

maintenant compter parmi ces sources.

SuperCollider 3

est un puissant et flexible langage de programmation "orienté objets"

pour synthèse et traitement du son et de l'image. Il a été développé par James

McCartney, sa syntaxe et ses librairies des fonctions sont dérivées de SmallTalk

et C++, il a été mis en circulation en 1996 sur sa version 2 puis en 2002

publié sous GNU (General Public License). La dernière version 3.3

datant d'avril 2009.

SuperCollider 3

est en fait deux applications tournant en même temps : sclang et scsynth,

le langage et le moteur de synthèse, les deux applications communiquant à

travers un réseau via UDP ou TCP et un utilisant un sous-ensemble du protocole Open

Sound Control (OSC) développé par le CNMAT.

Cette architecture

permet d'envoyer des messages au moteur de synthèse dans deux styles différents

:

· Directement : en utilisant la méthode ".sendMsg"

sur une instance de " Server " et en utilisant

la syntaxe OSC.

· Indirectement : en utilisant la syntaxe propre au sclang que

permet de suivre et manipuler les objets créés dans le serveur :

"Server". Ainsi sclang traduit cette syntaxe haut niveau dans

des messages OSC de bas niveau et des envois au serveur.

Par exemple, les

deux types de syntaxe suivants sont équivalents :

Créer une instance

de "Server", le démarrer, créer un synthétiseur (celui définie par

défaut) et l'assigner un identifiant dans l'arborescence de synthèse, puis

l'arrêter.

style OSC

s

= Server.default;

s.boot;

s.sendMsg(\s_new,\default,1001,1,1);

s.sendMsg(\n_free,1001);

style sclang

s

= Server.default;

s.boot;

x

= Synth("default")

;

x.free;

En étant

équivalents, le choix entre les deux peut obéir à des raisons de contexte ou de

goût personnel.

D'autres logiciels

(MaxMSP PureData) capables d'utiliser le protocole OSC peuvent aussi envoyer des

messages directement au scsynth.

Pour faciliter la

lecture de mes exemples et clarifier la syntaxe, voici quelques conventions

dans la typographie. Le code sera écrit dans la police Monaco 10

window

= GUI.window.new("JabaLion",

Rect(6, 6, 260, 230)).front;

Une

"classe" commence toujours par une majuscule (ex : Server)

La classe est une

structure informatique particulière dans le langage objet. Elle décrit la

structure interne des données, et elle définit les méthodes qui s'appliqueront

aux objets de même famille (même classe) ou type. Elle propose des méthodes de

création des objets dont la représentation sera donc celle donnée par la classe

génératrice. Les objets sont dits alors instances de la classe. C'est pourquoi

les attributs d'un objet sont aussi appelés variables d'instance et les

messages opération d'instance ou encore méthodes d'instance. L'interface de la

classe (l'ensemble des opérations visibles) forme les types des objets.

Une

variable locale est définie par le caractère « ~ »

~myvariable = 888;

équivalent à :

currentEnvironment.put(\myvariable, 888);

Les symboles sont

précédés par le caractère « \ », ou entre guillemets simples « '

' » et dans la syntaxe colorée ils deviennent verts.

Un symbole est un nom unique garanti comme unique, ils peuvent être

utilisés pour représenter des valeurs constantes, des entrées dans des

dictionnaires, des noms de synthétiseurs...

\granulator 'granulator'

Un vecteur de caractères ou "string" est écrit entre guillemets

doubles et est coloré dans la syntaxe en gris.

"ceci est un vecteur de caractères".postln

Les commentaires à l'intérieur du code sont précédés par « // »

ou en commençant et en finissant par /* ... */

Ils seront colorés en rouge.

// sc libeary file Automation,MP3,FileListView,Arduino;

/*

Document.current.bounds_(Rect(2, 141, 940, 640));

s.options.device = "Digidesign HW ( MBox )"

s.boot;

{ SinOsc.ar(440, 0, 0.5) }.play;

*/

Les parenthèses « () » servent à définir des bloques de

code exécutable ou pour passer des

valeurs ou arguments à des fonctions

(~values.matrixprocessing.integrateRow_(12))

Les vecteurs sont écrits à l'intérieur de crochets « [] »,

un vecteur est une collection d'objets de nature similaire ou différente.

[["On",Color.white,Color.green],["Off",Color.white,Color.red]]

Les fonctions sont écrites à l'intérieur d'accolades « {} »

{~values.matrixoutputs.front_(true)}.value;

Les arguments dans

une fonction sont précédés par le mot-clé arg ou écrits à l'intérieur de barres verticales « || »

~values.ucontrol.setAction_(1,12,{arg ez;

~values.complexattack.setreal_(ez.value)});

~values.ucontrol.setAction_(1,12,{|ez|

~values.complexattack.setreal_(ez.value)});

Les variables dans

une fonction sont déclarées et précédées par le mot-clé var

var server = Server.local,window,devices=ServerOptions.devices

Dans une classe

les chevrons <> servent à définir les méthodes "get " > ou "set"

<

AudioStereo {

var

adcwindow,<>play,levelsadcviews,<>ezvol;

...}

AudioStereo.play;

AudioStereo.play_(value);

Arborescence de

synthèse : ordre d'exécution

L'ordre

d'exécution est un des points critiques en SuperCollider, il ne se réfère pas à

l'ordre d'exécution d'assertions dans le langage mais à l'ordre de nœuds de

synthèse dans le serveur, c'est à dire l'ordre dans lequel leur sortie est

calculée à chaque cycle de contrôle (blockSize) ainsi chaque synthé est

placé dans un lieu unique et spécifique dans la chaîne d'exécution.

Par exemple :

NODE TREE Group 0

1 group

1001 default

1002 fm

2 group

1003 granulator

Ceci veut dire que

toutes les unités génératrices du synthé default placé dans le premier groupe avec l'identifiant (id) 1001 seront

calculées avant celles du synthé fm ou id 1002 à chaque cycle. Ce fait est crucial dans le traitement

du signal car si par exemple le granulator 1003 arrivait avant le groupe 2, on n'aurait pas le traitement car

le synthé granulator resterait toujours à l'attente du son à traiter car la sortie du default et fm ne serait calculée

qu'après.

SuperCollider

propose donc plusieurs messages et commandes pour organiser et placer les nœuds

et les groupes des nœuds dans l'ordre désiré. Dans le groupe de discussion

organisé par l'université de Birmingham, il y a aussi l'idée d'implémenter une

méthode « order » pour le Serveur qui permettrait de faciliter la

tâche en envoyant un vecteur du type "[id synth, new id]". Méthode

qui existe déjà dans la librairie JIT (Just In Time Programming) et qui

utilise et étend les possibilités des espaces proxies dans SuperCollider.

Dans mon

implémentation, j'utilise InFeedback.ar qui permet de récupérer des signaux qui sont plus tard dans l'arbre

de synthèse. Toutefois, l'ordre auquel les synthés sont créés dans le serveur

est capital pour un fonctionnement correct du programme et il faut rester

vigilant.

La classe Synth dans SuperCollider est la représentation dans le langage d'un nœud

de synthèse dans le serveur. Un Synth représente une unité

produisant du son. Les opérations que cette unité réalise sont définies avec la

classe SynthDef où les UGens (unités génératrices) sont spécifiées et connectées et aussi les

types d'entrés et sorties qu'aura le synthé. Un SynthDef est une sorte de modèle fixe sur lequel les Synth sont basés.

Dans Jabalion

j'utilise 17 synthés différents pour accomplir les tâches de production et

traitement sonore.

Ces dix-sept

synthés sont divisés en deux groupes, les sources et les traitements, dans les

sources il y aura :

- deux entrées

analogiques

- cinq lecteurs

d'archives

- trois

algorithmes de synthèse : modulation de fréquence, synthèse dynamique stochastique.

Pour connaître ou

spécifier l'endroit où le programme sauvegarde les synthés, exécuter :

SynthDef.synthDefDir

Voici le synthé #1

qui permet d'avoir deux entrées analogiques.

// ADC audio in

SynthDef(\AudioIn,

{|inBus=0,vol=1, out1=20,out2=21,out3=22,out4=23,out5=24,out6=25,out7=26,out8=27,

out9=28,out10=29,out11=30,out12=31,out13=32,out14=33,out15=34,

amp1=0,amp2=0,amp3=0,amp4=0,amp5=0,amp6=0,amp7=0,amp8=0,amp9=0,amp10=0,amp11=0,amp12=0,amp13=0,amp14=0,amp15=0|

var sig,imp,delimp,env,mix,ch1,ch2,ch3,ch4,ch5,ch6,ch7,ch8,ch9,ch10,

ch11,ch12,ch13,ch14,ch15;

imp

= Impulse.kr(10);

delimp

= Delay1.kr(imp);

env

= Linen.kr(gate, 2, 1, 2, 2);

sig

= SoundIn.ar(inBus);

sig

= sig * vol * env;

mix

= [sig*amp1,sig*amp2,sig*amp3,sig*amp4,sig*amp5,sig*amp6,sig*amp7,

sig*amp8,sig*amp9,sig*amp10,sig*amp11,sig*amp12,sig*amp13,sig*amp14,sig*amp15];

#ch1,ch2,ch3,ch4,ch5,ch6,ch7,ch8,ch9,ch10,ch11,ch12,ch13,ch14,ch15

=

DistributedOut.ar([out1,out2,out3,out4,out5,out6,out7,out8,out9,out10,

out11,out12,out13,out14,out15],mix);

SendReply.kr(imp,'levels',

[Amplitude.kr(sig),K2A.ar(Peak.ar(sig, delimp).lag(0, 3))]);

}).writeDefFile(SynthDef.synthDefDir)

Regardons quelques

détails du code. Le nom du synthé est déclaré comme un symbole (\AudioIn), il suivent les arguments, numéro du bus audio d'entrée, les

canaux de sorties, le niveau de chaque canal, puis le variable où je déclare

par exemple sig qui n'est autre que le convertisseur audio numérique des entrées

analogiques de la carte son.

J'ai été amené à

écrire une classe DistributedOut pour avoir un accès facile aux sorties de chaque synthé et ainsi

avec l'aide d'une matrix diriger les

signaux dans des buses pour établir un mapping

et contrôler l'arborescence de synthèse. Ce à quoi sert cette classe est de recevoir

un vecteur de canaux et d'amplitudes non conjoints et de les assigner à des buses

audio, ces signaux seront acheminés vers les entrées de synthés traitement ou

directement vers les sorties (8) de la carte son.

Un autre point

commun à tous mes synthés est l'affichage graphique du niveau de sortie. Pour

ceci j'utilise la classe SendReply qu'envoie un message osc

('levels') de l'amplitude instantanée avec des pics (Amplitude, Peak) à un taux déterminé (ici tous le 100 ms) produit par l'oscillateur

d'impulses, à l'interface graphique. La classe K2A convertit des signaux à taux contrôlé vers le taux audio.

Les UGens (Unités génératrices) sont les

bloques basiques pour la construction de synthés dans le serveur et sont

utilisés pour générer ou traiter les signaux d'audio et de contrôle (avec le

message .ar (audio rate) ou .kr (control rate). Ils fonctionnent à des taux différents :

44100, 48100... échantillons par seconde pour l'audio, 690 pour le taux de

contrôle ou un valeur tous le 64 valeurs de l'audio rate). Chaque synthé a

aussi une enveloppe simple (env) pour adoucir les entrées et les extinctions du synthé : env = Linen.kr(gate,

2, 1, 2, 2); les arguments correspondent à : Linen.kr(

gate = 1.0, attackTime = 0.01, susLevel = 1.0, releaseTime = 1.0, doneAction =

0 ) l'argument "donneAction"

permet de déterminer une action à accomplir lors de la fin de l'enveloppe ainsi

:

0 ne

rien faire

1 pause

le synthé mais ne le libère pas

2 libère

le synthé

3 libère

le synthé et le nœud précédent

4 libère

le synthé et le nœud suivant

5 libère

le synthé, si le nœud précédent est un groupe donc libère-le

6 libère

le synthé, si le nœud suivant est un groupe donc libère-le

7 libère

le synthé et tous les nœuds précédents dans ce groupe

8 libère

le synthé et tous les nœuds suivants dans ce groupe

9 libère

le synthé et pause le nœud précèdent

10 libère le

synthé et pause le nœud suivant

11 libère le

synthé et tous les groupes précédents

12 libère le

synthé et tous les groupes suivants

13 libère le

synthé et tous les groupes précédents et suivants

14 libère tous

les groupes et tous les nœuds

La méthode .writeDefFile permet d'écrire cette définition dans le disque dur et ainsi on peut

créer des instances de cette définition sans les déclarer à chaque fois, car au

démarrage du serveur elles sont automatiquement chargées.

Le synthétiseur

numéro 2 est celui qui me permet de lire des archives sonores

// Lecteur de Fichiers Sons

SynthDef(\samples,

{|bufnum=0,rate=1,t_trig=1,start=0,end=1,vol=1,loop=1,t_gate=1,

numchannels=1,dur=1,out1=20,out2=21,out3=22,out4=23,out5=24,out6=25,out7=26,out8=27,out9=28,out10=29,out11=30,out12=31,out13=32,out14=33,

out15=34,amp1=0,amp2=0,amp3=0,amp4=0,amp5=0,amp6=0,amp7=0,amp8=0,amp9=0,amp10=0,amp11=0,amp12=0,amp13=0,amp14=0,amp15=0|

var sig,val,phase,imp,delimp,env,ch1,ch2,ch3,ch4,ch5,ch6,ch7,ch8,ch9,

ch10,ch11,ch12,ch13,ch14,ch15;

val

= BufFrames.kr(bufnum);

imp

= Impulse.kr(10);

delimp

= Delay1.kr(imp);

env

= Env.linen(0.2,dur,0.2,1,'welch');

phase=Phasor.ar(t_trig,BufRateScale.kr(bufnum)*rate,start*val,end*val);

sig

= BufRd.ar(1,bufnum,phase,loop,4);

sig

= sig * (EnvGen.kr(env,t_gate,doneAction:2));

sig

=sig*vol;

SendReply.kr(imp,

'phasor', phase);

SendReply.kr(imp,'levels',

[Amplitude.kr(sig),K2A.ar(Peak.ar(sig, delimp).lag(0, 3))]);

sig=[sig*amp1,sig*amp2,sig*amp3,sig*amp4,sig*amp5,sig*amp6,sig*amp7,

sig*amp8,sig*amp9,sig*amp10,sig*amp11,sig*amp12,sig*amp13,sig*amp14,sig*amp15]

#ch1,ch2,ch3,ch4,ch5,ch6,ch7,ch8,ch9,ch10,ch11,ch12,ch13,ch14,ch15

=

DistributedOut.ar([out1,out2,out3,out4,out5,out6,out7,out8,out9,out10,out11,out12,out13,out14,out15],sig);

}).writeDefFile(SynthDef.synthDefDir);

Ce synthé lit un buffer

chargé en mémoire avec une indexation produit par un oscillateur Phasor sur lequel on peut contrôler la fréquence donc la vitesse de lecture

du fichier, le point de départ et le point de fin en frames (quantité

d'échantillons fois les canaux). La classe BufFrames retourne la quantité des frames dans le buffer et la

classe BufRateScale permet de varier la vitesse de lecture du buffer.

Autre détail est

l'argument t_trig est t_gate qui déclenchent l'oscillateur ou l'enveloppe à chaque fois qu'on les

appelle trigger sans le

préfixe t_ les déclenchements

n'auraient lieu qu’à chaque transition, des valeurs négatives vers des valeurs

positives.

Les trois synthés

suivants produisent des données audio en utilisant trois algorithmes différents

de synthèse.

// FMPlayer

SynthDef(\fm,{|gate=1,rate=20,freq=440,modfreq=200,

index, amp, dur=0.2

out1=20,out2=21,out3=22,out4=23,out5=24,out6=25,out7=26,out8=27,

out9=28,out10=29,out11=30,out12=31,out13=32,out14=33,out15=34,

amp1=0,amp2=0,amp3=0,amp4=0,amp5=0,amp6=0,amp7=0,amp8=0,amp9=0,amp10=0,amp11=0,amp12=0,amp13=0,amp14=0,amp15=0|

var sig,imp,delimp;

var

ch1,ch2,ch3,ch4,ch5,ch6,ch7,ch8,ch9,ch10,ch11,ch12,ch13,ch14,ch15;

sig

= FMGrain.ar(Impulse.ar(rate),dur,freq,modfreq,index, EnvGen.kr(Env([0,

1, 0], [1, 1], \sin, 1),gate,doneAction:

2))*amp;

imp

= Impulse.kr(10);

delimp

= Delay1.kr(imp);

SendReply.kr(imp, 'levels',[Amplitude.kr(sig), K2A.ar(Peak.ar(sig, delimp).lag(0, 3))]);

sig

= [sig*amp1,sig*amp2,sig*amp3,sig*amp4,sig*amp5,sig*amp6,sig*amp7,

sig*amp8,sig*amp9,sig*amp10,sig*amp11,sig*amp12,sig*amp13,sig*amp14,

sig*amp15];

#ch1,ch2,ch3,ch4,ch5,ch6,ch7,ch8,ch9,ch10,ch11,ch12,ch13,ch14,ch15

=

DistributedOut.ar([out1,out2,out3,out4,out5,out6,out7,out8,out9,out10,out11,out12,out13,out14,out15],sig);

}).writeDefFile(SynthDef.synthDefDir) ;

Ce synthé basé sur

le paradigme de la modulation de fréquence

a pour UGen principale FMGrain écrite par Joshua Parmenter

de l'Université de Washington, et fait partie d'une librairie sur la synthèse

granulaire.

Il s’agit donc

d’une combinaison de deux techniques, la modulation de fréquence et la synthèse

granulaire. Je l’ai choisi par le résultat sonore très riche et sa simplicité

pour être intégré dans un environnement multi traitement comme Jabalion. Cette

classe a pour arguments :

*ar(trigger, dur, carfreq, modfreq, index, mul, add) ;

Le trigger

que retourne un nouveau grain à chaque impulsion, dur qui représente la

taille du grain, puis pour chaque grain carfreq ou Fréquence Porteuse, modfreq ou Fréquence Modulante, index de modulation ou profondeur et comme dans tous les UGens dans SuperCollider mul et add,

mul est un facteur multiplicateur de

la sortie, c'est à dire dans de signaux audio le résultat sera un incrément de

niveau, le valeur par défaut est 1, ainsi le signal oscille entre -1 et 1, 0

étant le silence. add est un facteur qui s'ajoute ou se somme à la

sortie, ceci est intéressant pour le calibrage des signaux contrôle pour les

limiter dans une échelle des valeurs.

Celui-ci est un

synthétiseur très puissant du point de vue expressif car chaque modification

dans les paramètres est très saisissante pour la perception. Comme je vais l’expliquer

plus loin tous les paramètres de contrôle ont été normalisés entre 0 et 1, ceci

oblige à manier des valeurs relatives sur le synthétiseur plus que de valeurs

absolues. Par exemple les fréquences porteuse et modulante oscillent entre 20Hz

et 20kHz mais une interpolation exponentielle permet de passer à des valeurs de

0 et 1 faisant le contrôle plus intuitif que mathématique.

SynthDef(\gendy, {|gate=1,ampdist=1,durdist=1,adparam=1,ddparam=1,

minfreq=30,maxfreq=100,ampscale=0.3,durscale=0.05,initCPs=5,knum=12, vol=1.0, out1=20,out2=21,out3=22,out4=23,out5=24,out6=25,out7=26,out8=27,

out9=28,out10=29,out11=30,out12=31,out13=32,out14=33,out15=34,

amp1=0,amp2=0,amp3=0,amp4=0,amp5=0,amp6=0,amp7=0,amp8=0,amp9=0,amp10=0,amp11=0,amp12=0,amp13=0,amp14=0,amp15=0|

var sig,imp,delimp;

var

ch1,ch2,ch3,ch4,ch5,ch6,ch7,ch8,ch9,ch10,ch11,ch12,ch13,ch14,ch15;

sig

= Gendy1.ar(ampdist, durdist, adparam, ddparam,

minfreq, maxfreq, ampscale, durscale, initCPs,knum,

EnvGen.kr(Env([0, 1, 0], [1, 1], \sin,

1),gate,doneAction: 2),0) * vol;

imp

= Impulse.kr(10);

delimp

= Delay1.kr(imp);

SendReply.kr(imp, 'levels',

[Amplitude.kr(sig),

K2A.ar(Peak.ar(sig,

delimp).lag(0, 3))]);

sig

= [sig*amp1,sig*amp2,sig*amp3,sig*amp4,sig*amp5,sig*amp6,sig*amp7,

sig*amp8,sig*amp9,sig*amp10,sig*amp11,sig*amp12,sig*amp13,sig*amp14,

sig*amp15];

#ch1,ch2,ch3,ch4,ch5,ch6,ch7,ch8,ch9,ch10,ch11,ch12,ch13,ch14,ch15

=

DistributedOut.ar([out1,out2,out3,out4,out5,out6,out7,out8,out9,out10,out11,out12,out13,out14,out15],sig);

}).writeDefFile(SynthDef.synthDefDir))

Ce synthétiseur

est une implémentation de la synthèse dynamique stochastique, décrite par

Iannis Xenakis dans "Formalized Music".

Le programme de base a été écrit par Marie-Helene Serra. La méthode consiste à

calculer chaque période de la forme d'onde à l'aide des distributions

stochastiques. Les variables sont : la quantité des points sur lesquelles on

pourra contrôler les positions bidimensionnelles dans un plan où les ordonnées

représentent l'amplitude et les abscisses le temps, les limites maximum et

minimum pour l'ensemble des points et le type de distribution dans les options

suivantes : 0- LINEAR, 1- CAUCHY, 2- LOGIST, 3- HYPERBCOS, 4- ARCSINE, 5- EXPON,

6- SINUS

Ainsi, une fois

calculée la première période d'onde, chaque point suit l'opération de

distribution et obtient une nouvelle valeur. Cette période en millisecondes

sera égale à la somme des positions de chaque point sur l'axe des "x"

et peut être normalisé de façon à avoir une périodicité mais un contenu spectral

très complexe.

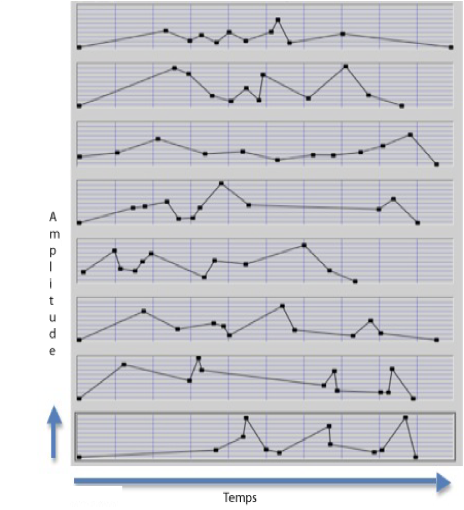

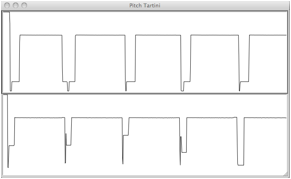

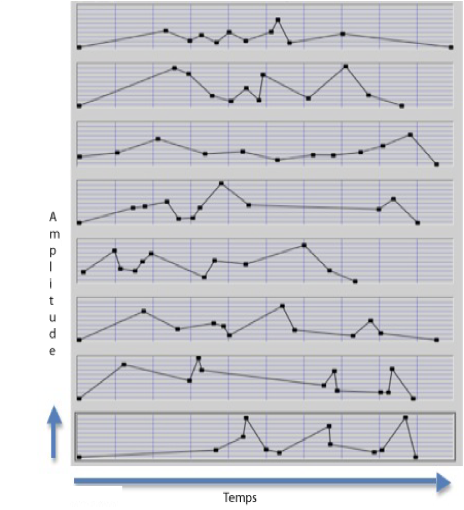

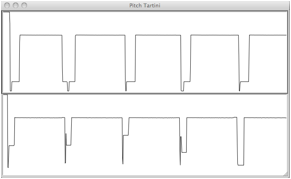

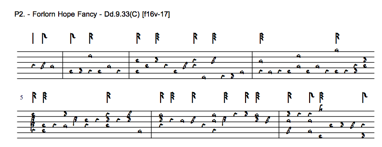

Le graphique

suivant est une illustration de ce procédé. On peut constater comme la forme

d’onde varie un peu capricieusement ce qui produit des sons très riches et

vivants quand on les enchaîne. La longueur et donc la période de chaque

variation est modifiée avec le même procédé stochastique.

class=Section10>

2.2.3.3. k-means

Passons maintenant

au dernier procédé de synthèse utilisé dans ce travail. Il s’agit de k-means,

encore une technique basée dans un procédé de calcul de probabilités : Le partitionnement

de données (data clustering en anglais) est une méthode statistique d'analyse des données qui a pour but de regrouper un ensemble de données en différents

paquets homogènes, en ce sens que les données de chaque sous-ensemble partagent

des caractéristiques communes, qui correspondent le plus souvent à des critères

de proximité que l'on définit en introduisant des mesures de distance.

C’est à dire à

partir d’un flux aléatoire on répète itérativement un regroupement des données

dans un espace à deux dimensions pour obtenir de formes d’onde, joués par un

oscillateur. Cette technique est donc très proche dans le résultat sonore de

ceux obtenus avec la synthèse dynamique stochastique de Xenakis.

Les paramètres de

contrôle de cet algorithme sont :

freq- fréquence

de l’oscillateur

numdatapoints- Nombre

initial de points.

maxnummeans- Maximum

nombre de « means » ou mesures de distance

nummeans- Nombre

actuel de « means »

tnewdata- Si un

trigger est reçu réinitialiser le flux de données (k-rate)

tnewmeans- Si un

trigger est reçu réinitialiser means (k-rate)

soft- Taux

d’actualisation de « means ». 1.0 actualisation immédiate, 0.0 pas

d’actualisation.

bufnum- cette

option permet d’utiliser les donnés stockés dans un buffer comme point de

départ pour les donnés sur lequel l’opération de probabilité seront effectués.

Ici le code pour l’implémentation de cet

algorithme dans mon programme.

// Kmeans

SynthDef(\kmeans,{|gate=1, freq=220, nummeans=4,

soft=0.01, rate=10, vol=0.1,out1=20,out2=21,out3=22,out4=23,out5=24,out6=25,out7=26,

out8=27,out9=28,out10=29,out11=30,out12=31,out13=32,out14=33,out15=34,

amp1=0,amp2=0,amp3=0,amp4=0,amp5=0,amp6=0,amp7=0,amp8=0,amp9=0,amp10=0,amp11=0,amp12=0,amp13=0,amp14=0,amp15=0|

var sig,imp,delimp,env;

var

ch1,ch2,ch3,ch4,ch5,ch6,ch7,ch8,ch9,ch10,ch11,ch12,ch13,ch14,ch15;

env

= Linen.kr(gate, 2, 1, 4, 2);

sig

= Mix(vol*env*KmeansToBPSet1.ar(freq*[1,3/2,5/4,7/6],20,4,nummeans,

Impulse.kr(0.2),Impulse.kr(rate),soft));

imp

= Impulse.kr(10);

delimp

= Delay1.kr(imp);

SendReply.kr(imp,'levels',

[Amplitude.kr(sig),K2A.ar(Peak.ar(sig,delimp).lag(0, 3))]);

sig

= [sig*amp1,sig*amp2,sig*amp3,sig*amp4,sig*amp5,sig*amp6,sig*amp7,

sig*amp8,sig*amp9,sig*amp10,sig*amp11,sig*amp12,sig*amp13,sig*amp14

sig*amp15];

#ch1,ch2,ch3,ch4,ch5,ch6,ch7,ch8,ch9,ch10,ch11,ch12,ch13,ch14,ch15

=

DistributedOut.ar([out1,out2,out3,out4,out5,out6,out7,out8,out9,

out10,out11,out12,out13,out14,out15],sig);

}).writeDefFile(SynthDef.synthDefDir));

Dans Jabalion il y a huit modules de

traitement du signal et comme je l’ai mentionné plus haut, ces modules sont des

nœuds de synthèse dans l’arborescence de SuperCollider, donc dans le code ils

sont aussi écrits comme synthétiseurs.

- Pitch shifter.

- Modulations.

- Retardes modulés.

- Réverbération.

- Multi-delays.

- Vocodeur de phase

- Freezer et time stretching.

- Granulateur.

D’un point de vue technique ces modules

sont des implémentations de différentes familles de traitements : de

lignes à retard, modulations, transformés de Fourier et synthèse granulaire.

L’ordre indiqué ci-dessus est celui présenté dans le logiciel et si bien semble

un peu arbitraire, il s’est conformé d’après une exploration de ces différentes

techniques.

Pour des raisons d’analyse et de clarté

je vais les présenter ici en suivant le type de technique utilisé dans chaque

algorithme : modulations, lignes à retard, transformées de Fourier et

synthèse granulaire.

Dans ce synthétiseur il s’agit d’une

implémentation de la modulation d’amplitude unipolaire. Toutes les

composantes du signal sont « décalées » par un facteur fixe.

// modulation d’amplitude et wah

(

SynthDef(\modulations,{|inBus=22, gate=1,

wet=1, modfreq=100, modlevel=0, lforate=1, filtfreq=100, lfovol = 1,

out1=20,out2=21,out3=22,out4=23,out5=24,out6=25,out7=26,out8=27,

out9=28,out10=29,out11=30,out12=31,out13=32,out14=33,out15=34,

amp1=0,amp2=0,amp3=0,amp4=0,amp5=0,amp6=0,amp7=0,amp8=0,amp9=0,amp10=0,amp11=0,amp12=0,amp13=0,amp14=0,amp15=0|

var

sig,mix,ring,wah,mixwet;

var

imp,delimp,env,ch1,ch2,ch3,ch4,ch5,ch6,ch7,ch8,ch9,ch10,ch11,ch12,

ch13,ch14,ch15;

imp

= Impulse.kr(10);

delimp

= Delay1.kr(imp);

env

= Linen.kr(gate, 2, 1, 4, 2);

sig

= InFeedback.ar(inBus);

ring

= FreqShift.ar(sig, modfreq,0) * modlevel;

wah

= RLPF.ar(sig, LinExp.kr(

LFNoise1.kr(lforate), -1, 1, 200, filtfreq), 0.1)

* lfovol;

mix

= Mix.new([ring,wah]);

sig

= (sig * (1 - (wet*env))) + (mix * (wet*env));

SendReply.kr(imp,

'levels',

[Amplitude.kr(sig), K2A.ar(Peak.ar(sig, delimp).lag(0, 3))]);

sig

= [sig*amp1,sig*amp2,sig*amp3,sig*amp4,sig*amp5,sig*amp6,sig*amp7,sig*amp8,sig*amp9,sig*amp10,sig*amp11,sig*amp12,sig*amp13,sig*amp14,sig*amp15];

#ch1,ch2,ch3,ch4,ch5,ch6,ch7,ch8,ch9,ch10,ch11,ch12,ch13,ch14,ch15

=

DistributedOut.ar([out1,out2,out3,out4,out5,out6,out7,out8,out9,out10,out11,out12,out13,out14,out15],sig);

}).writeDefFile(SynthDef.synthDefDir) );

Ce synthétiseur réalise deux types de

traitement, le signal d’entrée « sig » est passé par la modulation

d’amplitude freqShift, La

fréquence de modulation est contrôlée par la variable modfreq et le niveau par la variable modlevel. En parallèle le signal est routé à travers

un filtre passe bas RLPF dont la

fréquence de coupure meut entre une valeur maximum filterfreq et une valeur

aléatoire produit au taux lforate par

l’oscillateur LFNoise1. Ces valeurs

sont interpolées par une ligne convertissant des valeurs linaires dans des

valeurs logarithmiques LinExp. Cet effet

dont on module la fréquence de résonnance d’un filtre est connu comme « wah »

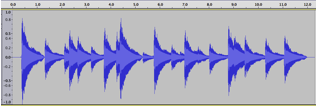

Pour illustrer ces deux traitements et

les exemples suivants, je vais utiliser un échantillon (son 1 plage1 CD) de son

de guitare : un mi3 joué à la première corde à vide, enregistré avec un

microphone statique cardioïde à 15 cm du point d’attaque (12cm du

chevalet) la fréquence d’échantillonnage est de 44.1 khz avec une résolution d’amplitude à 16 bits;

l’enregistrement est normalisé et pour

des raisons de facilité des calculs la durée a été fixée à1000 ms.

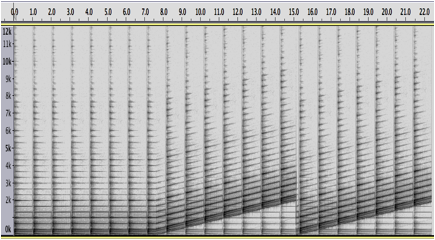

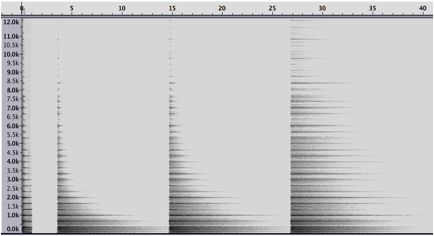

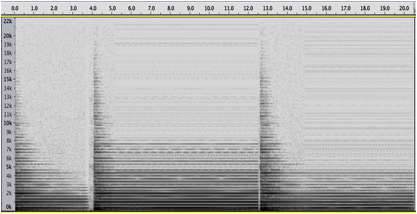

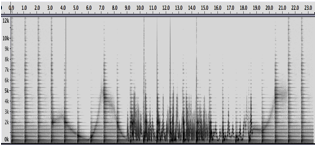

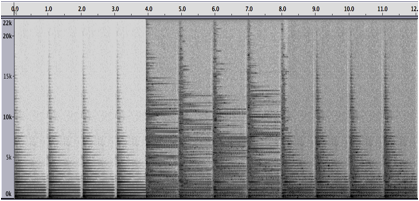

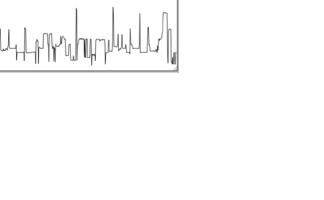

Le sonagramme suivant illustre l’effet

de « frequency shift ». L’analyse est faite avec une taille de FFT de

4096 et un type de fenêtre «Hanning» le range fréquentielle de 0 à 12 khz et la

durée est de 22 secondes.

Figure

2

Frequency Shift, déplacement spectral CD plage 2

Le son 1 est joué en bouclé, dans les deux

premières attaques il n’y a pas de traitement, c’est la référence, à partir du

troisième une modulation de 10 hz est introduite et mixé avec l’archive

d’origine, la résolution fréquentielle de l’analyse ne permet pas de mettre en

valeur cette variation mais sur les huit attaques qui suivent, une ligne entre

10 et 2000 hz contrôle la fréquence de modulation qui est clairement illustrée.

À la quinzième seconde de l’exemple la ligne

recommence avant la seizième attaque. On constate sur le sonagramme que toutes

les composantes du spectre sont décalées et le spectre originel diminue en

amplitude.

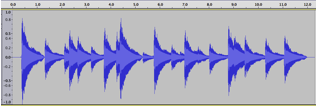

Dans l’exemple suivant le son 1 est joué

en bouclé et traité par le filtrage du type wah

décrit plus haut. La fréquence de coupure du filtre est réglée à 5khz. Les

paramètres d’analyse sont les mêmes que pour l’exemple précédent.

Figure

3

Modulations « wah » CD plage 3

Il y a cinq moments dans cet exemple :

le premier est le son de référence (trois attaques), après le taux de variation

pour l’oscillateur aléatoire est réglé à 5% (six attaques), puis à 100% (six

attaques), puis à 25% (trois attaques), 5%(trois attaques) et pour finir à 0%

(deux attaques). Cet effet est très riche d’un point de vue sonore car amène

une certaine vie à l’intérieur du spectre, il a été très exploité par exemple dans

la musique rock. Ici, le

fait d’avoir introduit un degré d’imprévisibilité avec l’oscillateur aléatoire

permet de jouer sur la complexité du spectre en ajustant le taux de variation,

tout en gardant un contrôle conscient du traitement.

Cette technique est très riche dans ces

résultats sonores et produit donc une grande variété d’effets en suivant les

valeurs du retard, l’itération de ceux-ci et le taux de réinjection : échos,

réverbération, modulations, filtrages. Quand la valeur du retard dépasse 50 ms

(cette valeur de discrimination peut changer avec les sujets et le type de son étudié)

une répétition, un écho devient clair ; entre 1 ms et 10 ms

approximativement une modification spectrale du type filtrage (filtre un

peigne) est perçu, ce sont les « delays » courts; entre 10 et 50 ms le mixage des deux

signaux son direct son retardé, peut conduire à des annulations de phase. Cela

se traduit par un éclaircissement

de la fondamentale et de partiels supérieurs, c’est une technique

utilisé dans les effets de flanger et

chorus.

Mon premier exemple de ligne à retard

est la réverbération, il s’agit d’un traitement très saisissable, car

perceptivement il peut s’associer à un concept d’espace. La réverbération est

un effet physique produit par la réflexion des ondes sur des surfaces et donc

arrivant à l’auditeur avec de petits retards temporels par rapport au son

direct. Le taux d’arrivée de ces réflexions change dans le temps en fonction de

la taille et la forme de l’espace où le son se produit.

Les paramètres de contrôle peuvent être

très nombreux dans les simulations numériques de la réverbération, quelques

fois en faisant allusion à des paramètres perceptifs ou des fois très

techniques : temps de réverbération, facteur de diffusion, amortissement,

taille de la salle, facteur d’absorption, « predelays », « gate time »,

« gate decay time », « gate threshold » et bien d’autres.

La réverbération est tellement usée dans

le traitement du signal en studio et en concert que de nos jours les

« de-réverbérators » ou « enleveurs » de réverbération en

différentes formes algorithmiques ont vu le jour et sont devenus à la mode pour

nettoyer les signaux.

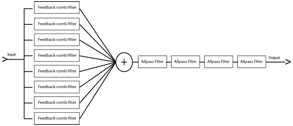

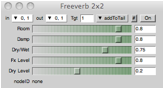

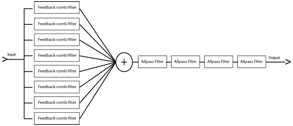

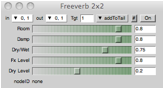

Dans cette implémentation, j’utilise un

algorithme d’après les travaux réalises par Manfred Schroeder

des Laboratoires Bell et écrite en C++, de distribution libre appelé « Freeverb ».

Pour simuler les effets de la réverbération, les algorithmes de Schroeder

proposent l'utilisation de délais, de filtres passe-tout et

de filtres en peigne. Les délais sont utilisés pour reproduire les réflexions

primaires de la salle et les filtres sont ensuite connectés en série et en

parallèle pour créer un nuage très dense de réverbération. Dans le diagramme

des bloques que suit il y a donc

quatre filtres passe-tout en série et huit filtres en peigne en

parallèle pour chaque canal audio.

Figure

4 Diagramme

des bloques réverbération d’après l’algorithme de Schroeder

Le code suivant est l’implémentation de

cette réverbération dont les paramètres de contrôle sont la taille de la salle room, un facteur d’amortissement damp un mixage avec le son direct wet et le niveau du traitement level.

// Freeverb

(

SynthDef(\reverb, {|inBus=24,gate=1, wet=1,

room=0.15, damp=0.5, vol=0

out1=20,out2=21,out3=22,out4=23,out5=24,out6=25,out7=26,out8=27,

out9=28,out10=29,out11=30,out12=31,out13=32,out14=33,out15=34,

amp1=0,amp2=0,amp3=0,amp4=0,amp5=0,amp6=0,amp7=0,amp8=0,amp9=0,amp10=0,amp11=0,amp12=0,amp13=0,amp14=0,amp15=0|

var sig;

var imp,delimp,env,ch1,ch2,ch3,ch4,ch5,ch6,ch7,ch8,ch9,ch10,ch11,ch12,

ch13,ch14,ch15;

imp

= Impulse.kr(10);

delimp

= Delay1.kr(imp);

env

= Linen.kr(gate, 2, 1, 4, 2);

sig

= InFeedback.ar(inBus);

sig

= FreeVerb.ar(sig,wet,room,damp,vol);

SendReply.kr(imp,

'levels',

[Amplitude.kr(sig), K2A.ar(Peak.ar(sig, delimp).lag(0, 3))]);

sig

=

[sig*amp1,sig*amp2,sig*amp3,sig*amp4,sig*amp5,sig*amp6,sig*amp7,sig*amp8,sig*amp9,sig*amp10,sig*amp11,sig*amp12,sig*amp13,sig*amp14,

sig*amp15];

#ch1,ch2,ch3,ch4,ch5,ch6,ch7,ch8,ch9,ch10,ch11,ch12,ch13,ch14,ch15

=

DistributedOut.ar([out1,out2,out3,out4,out5,out6,out7,out8,out9,out10,

out11,out12,out13,out14,out15],sig);

}).writeDefFile(SynthDef.synthDefDir));

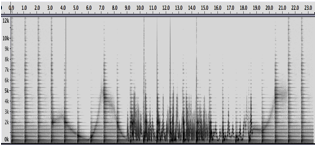

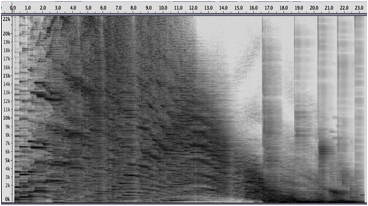

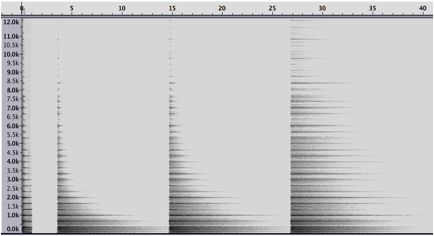

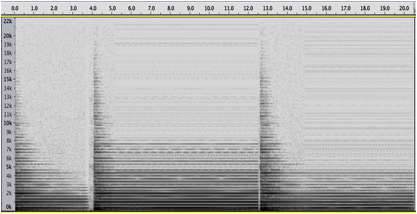

Sur la page suivante je présente un sonagramme

qu’illustre ce traitement et notamment le facteur d’amortissement

« dump » sur mon archive source (son 1). Le première attaque est le

son de référence, les trois suivantes ont la variable « taille de la

salle » (room size) à 100% puis respectivement

le facteur d’amortissement à 100%, 50% et 1%.

Bien que j’ai borné l’analyse à 12Khz le

spectre présente encore des composantes aiguës au-dessus de cette limite, car

je voulais focaliser l’observation dans l’enrichissement du spectre.

Figure

5 Effet de réverbération CD plage 4

On voit comment au fur et à mesure que le facteur d’amortissement

diminue les composantes aigües ont une durée plus longue, on entend les retards

se mêlant comme de rebondissements très diffus de l’attaque. L’énergie de la

fondamentale est réduite et un sentiment de nuage sonore ou de grand espace lié

aussi à la disparition des transitoires d’attaque.

Passons maintenant à des retards longs. J’ai dit plus haut que les

retards du signal autour de 50 ou 100 ms en présence du son direct commencent à

se différencier dans l’attaque, dont un effet d’écho est perçu. Ceci est très

intéressant de point de vue musical car on peut construire des structures

rythmiques où on contrôle le temps de séparation entre les attaques, le niveau

et la quantité de ces répétitions.

On peut imaginer des retards très longs où la seule limite est la mémoire vive

de l’ordinateur et donc la taille du buffer qui va stoker le signal.

Le principe consiste donc à avoir un buffer qui reçoit le signal

d’entrée en permanence et sur lequel on bien lire à différents moments ce signal.

Dans l’implémentation qui suit, j’utilise un buffer de 20 secondes et un

vecteur de lecture de 20 valeurs possibles. Ce qui veut dire que le buffer peut

être lu à 20 moments différents et la distance temporelle maximum entre deux

lectures consécutives est limité à 1 seconde.

// MultiDelay

(SynthDef(\multidelay, { |inBus

= 25,gate=1,wet=1,vol=1,buf=20,

timedel1,timedel2,timedel3,timedel4,timedel5,timedel6,timedel7,

timedel8,timedel9,timedel10,timedel11,timedel12,timedel13,timedel14,

timedel15,timedel16,timedel17,timedel18,timedel19,timedel20,

ampdel1,ampdel2,ampdel3,ampdel4,ampdel5,ampdel6,ampdel7,ampdel8,

ampdel9,ampdel10,ampdel11,ampdel12,ampdel13,ampdel14,ampdel15,ampdel16,ampdel17,ampdel18,ampdel19,ampdel20,

out1=20,out2=21,out3=22,out4=23,out5=24,out6=25,out7=26,out8=27,

out9=28,out10=29,out11=30,out12=31,out13=32,out14=33,out15=34,

amp1=0,amp2=0,amp3=0,amp4=0,amp5=0,amp6=0,amp7=0,amp8=0,amp9=0,amp10=0,amp11=0,amp12=0,amp13=0,amp14=0,amp15=0|

var

in,phase,tap1,tap2,tap3,tap4,tap5,tap6,tap7,tap8,tap9,tap10,tap11,

tap12,tap13,tap14,tap15,tap16,tap17,tap18,tap19,tap20,env,sig,mix,

imp,delimp;

var

ch1,ch2,ch3,ch4,ch5,ch6,ch7,ch8,ch9,ch10,ch11,ch12,ch13,ch14,ch15;

in = InFeedback.ar(inBus);

phase = DelTapWr.ar(buf,

in);

// literal Array of times, 4 =

interpolation (cubic)

#tap1,tap2,tap3,tap4,tap5,tap6,tap7,tap8,tap9,tap10,tap11,tap12,

tap13,tap14,tap15,tap16,tap17,tap18,tap19,tap20

=

DelTapRd.ar(buf, phase,

[timedel1,timedel2,timedel3,timedel4,timedel5,timedel6,timedel7,

timedel8,timedel9,timedel10,timedel11,timedel12,timedel13,timedel14,

timedel15,timedel16,timedel17,timedel18,timedel19,timedel20],4,

[ampdel1,ampdel2,ampdel3,ampdel4,ampdel5,ampdel6,ampdel7,ampdel8,

ampdel9,ampdel10,ampdel11,ampdel12,ampdel13,ampdel14,ampdel15,ampdel16,ampdel17,ampdel18,ampdel19,ampdel20]);

env = Linen.kr(gate,

2, 1, 4, 2);

mix = Mix([tap2+tap4+tap6+tap8+tap10+tap12+tap14+tap16+tap18+tap20+

tap1+tap3+tap5+tap7+tap9+tap11+tap13+tap15+tap17+tap19]);

mix = mix * vol;

sig = (in * (1 - (wet*env))) + (mix * (wet*env));

imp = Impulse.kr(10);

delimp = Delay1.kr(imp);

SendReply.kr(imp, 'levels',

[Amplitude.kr(sig), K2A.ar(Peak.ar(sig, delimp).lag(0, 3))]);

sig = [sig*amp1,sig*amp2,sig*amp3,sig*amp4,sig*amp5,sig*amp6,sig*amp7,

sig*amp8,sig*amp9,sig*amp10,sig*amp11,sig*amp12,sig*amp13,sig*amp14,sig*amp15];

#ch1,ch2,ch3,ch4,ch5,ch6,ch7,ch8,ch9,ch10,ch11,ch12,ch13,ch14,ch15

=

DistributedOut.ar([out1,out2,out3,out4,out5,out6,out7,out8,out9,out10,out11,out12,out13,out14,out15],sig);

}).writeDefFile(SynthDef.synthDefDir) );

Les classes centrales dans cette implémentation sont DelTapWr et DelTapRd lesquelles permettent respectivement d’écrire et lire

dans le buffer. Le buffer est passe comme un argument nommé buf. timedel et ampdel sont des arguments pour déterminer la durée et

l’amplitude de chaque retard.

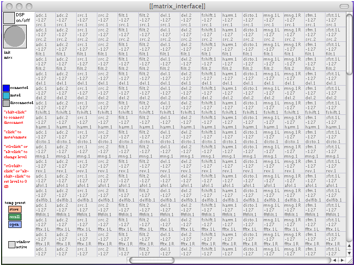

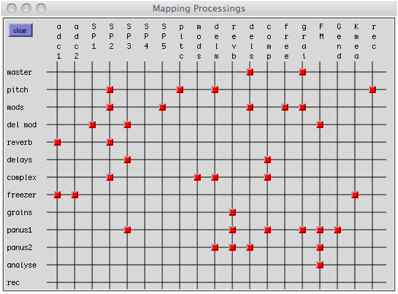

Sur

l’interface graphique on découvre le moyen de contrôler ces deux vecteurs :

avec deux multisliders, dont les

valeurs sont normalisés à 1. Pour le vecteur de temps de retard il faudra donc

penser calculer le temps absolu avec une opération d’intégration. En haut à

droite il y a deux menus qui permettent de choisir des configurations du type :

ritardando, accelerando, crescendo, diminuendo, aléatoire. Puis les

configurations trouvées à la main peuvent être stockées dans des archives

textes et charges postérieurement.

Sur

l’interface graphique on découvre le moyen de contrôler ces deux vecteurs :

avec deux multisliders, dont les

valeurs sont normalisés à 1. Pour le vecteur de temps de retard il faudra donc

penser calculer le temps absolu avec une opération d’intégration. En haut à

droite il y a deux menus qui permettent de choisir des configurations du type :

ritardando, accelerando, crescendo, diminuendo, aléatoire. Puis les

configurations trouvées à la main peuvent être stockées dans des archives

textes et charges postérieurement.

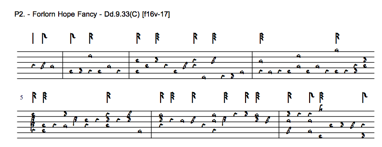

Dans le graphique, on voit sur la forme d’onde la structure

rythmique des vingt retards (le premier étant la référence) avec une

distribution aléatoire des amplitudes pour chaque retard. Ce traitement permet

de produire des structures rythmiques assez complexes et intéressantes.

Toutefois la limite de 20 retards est une contrainte car il faudrait modifier

le code de l’interface graphique. Pour manipuler les vecteurs de temps et

d’amplitude depuis une ligne de commande :

~values.multidelay.settimes_(Array.fill(20,{|i|i+i}).normalize.reverse)

~values.multidelay.setvols_(Array.fill(20,{|i|i+i}).normalize)

Soit on peut choisir d’écrire une fonction avec l’argument i soit bien écrire le vecteur à la main. J’ai

beaucoup travaillé dans l’implémentation d’une interpolation entre deux

configurations sauvegardées en mémoire, mais les résultats ne sont pas optimaux

car pour changer le temps de retard un par un dans les composantes du vecteur

il faut atteindre à ce que le retard soit joué, puis faire une ligne descendante

dans le volume, puis changer la valeur et finalement ramener le volume à la

valeur désirée. Malgré des grands efforts de calcul je continue à avoir des

clics et des distorsions, donc il faut encore imaginer des solutions pour bien

gérer cette interpolation.

Une troisième

application de cette technique de ligne à retard consiste à varier le temps de

retard d’une façon continue, ainsi on obtient comme son résultant des versions

transposées du signal d’origine. Ou de glissements dans la hauteur quand les

changements de vitesses sont continus. Un oscillateur du type « lfo »

peut être sur la tâche de modifier le point de lecture sur le buffer.

Un problème qui se

présente est celui de clics ou de sons non désirés produits par le fait de lire

le buffer à des endroits et vitesses différentes, donc il peut arriver de

coïncider sur un point qui est en train d’être écrit, ou quand la lecture se

boucle dans l’enchaînement de début et fin du fichier.

Pour contourner cette problématique, voici ma stratégie :

d’abord, il faut avoir un buffer suffisamment long pour laisser l’espace

nécessaire à l’écriture de la ligne à retard sans « retomber sur ses

pieds », puis le signal est passé par deux lignes de retard parallèles

mais retardées entre elles par la période de l’oscillateur lecteur (lfo),

après, l’amplitude de chaque ligne est contrôlée par deux oscillateurs

triangulaires pour produire un « crossfader »

au début de la lecture du fichier sur chaque répétition. Finalement une

troisième ligne à retard sert à contrôler le taux de réinjection.

// Ligne à retard modulé

(SynthDef(\delmod,{|inBus=23,gate=1,wet=1,transposition=0.5,delay=0.01,feedback=0,vol=1,buf=22,

out1=20,out2=21,out3=22,out4=23,out5=24,out6=25,out7=26,out8=27,

out9=28,out10=29,out11=30,out12=31,out13=32,out14=33,out15=34,

amp1=0,amp2=0,amp3=0,amp4=0,amp5=0,amp6=0,amp7=0,amp8=0,amp9=0,amp10=0,amp11=0,amp12=0,amp13=0,amp14=0,amp15=0|

var sig,mixwet,local,lfo,del1,del2;

var

imp,delimp,env,ch1,ch2,ch3,ch4,ch5,ch6,ch7,ch8,ch9,ch10,ch11,ch12,

ch13,ch14,ch15;

imp = Impulse.kr(10);

delimp = Delay1.kr(imp);

env = Linen.kr(gate,

2, 1, 4, 2);

sig = InFeedback.ar(inBus);

local = LocalIn.ar(1)

+ sig;

//buf = LocalBuf((44100*2),1);

lfo = LFSaw.kr(transposition,0).range(0,1);

del1 = BufDelayC.ar(buf,local,lfo,1)*

LFTri.kr(transposition.abs,0).range(0,1)*vol;

del2 = DelayC.ar(BufDelayC.ar(buf,local,lfo,1)*

LFTri.kr(transposition.abs,0).range(0,1)*

vol,20,transposition.reciprocal);

local = SwitchDelay.ar

(del1+del2,delayfactor:feedback,wetlevel:0.8,delaytime:delay)

*feedback;

local = LeakDC.ar(local);

local = Limiter.ar(local,1,0.01);

sig = (sig * (1 - (wet*env))) + (local * (wet*env));

LocalOut.ar(local * feedback);

SendReply.kr(imp, 'levels',

[Amplitude.kr(sig), K2A.ar(Peak.ar(sig, delimp).lag(0, 3))]);

sig =

[sig*amp1,sig*amp2,sig*amp3,sig*amp4,sig*amp5,sig*amp6,sig*amp7,

sig*amp8,sig*amp9,sig*amp10,sig*amp11,sig*amp12,sig*amp13,sig*amp14,

sig*amp15];

#ch1,ch2,ch3,ch4,ch5,ch6,ch7,ch8,ch9,ch10,ch11,ch12,ch13,ch14,ch15

=

DistributedOut.ar([out1,out2,out3,out4,out5,out6,out7,out8,out9,out10,out11,out12,out13,out14,out15],sig);

}).writeDefFile(SynthDef.synthDefDir));

Pourtant les clics produits par le changement de valeur dans la

durée du retard, ne sont pas évites. Pour ceci comme il est bien illustré dans

les tutoriaux de MaxMSP sur les objets « tapin » et « tapout »

il faudrait faire une limitation dans la vitesse de changement de cette

valeur, puis faire une ligne dans l’amplitude de façon à réaliser le changement

quand le signal est à zéro. Toutefois ces clics ou artefacts sonores peuvent

être exploités musicalement.

Les paramètres de contrôle de ce synthétiseur seront donc la

fréquence du lfo, (ici

l’argument : transposition), j’utilise un oscillateur en dent de

scie et sa fréquence oscillant entre -1 et 1, à -1 une inversion de phase dans

l’oscillateur est produite et donc la forme d’onde de celui-ci correspond à une

rampe descendante ; le temps du retard de la troisième ligne qui varie de

1ms à 1 seconde et le taux de réinjection exprimé en pourcentage du signal

renvoyé à l’entrée.

Un dernier commentaire sur l’architecture de ce synthétiseur :

remarquer la présence d’un filtre et un limiteur avant de réinjecter le

signal pour nettoyer les possibles effets de repliement spectral dus aux lignes

de retards.

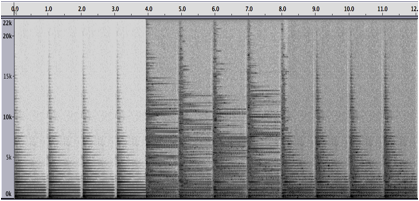

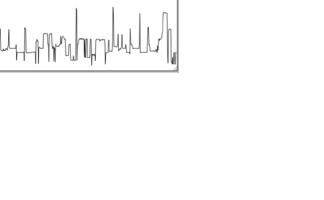

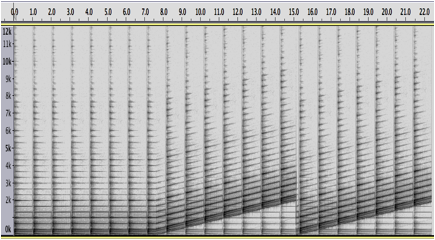

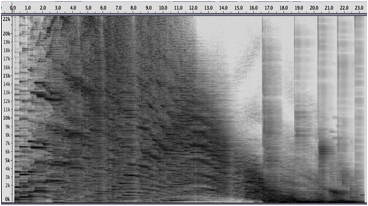

Pour illustrer la puissance génératrice

du taux de réinjection voici un son de 24 secondes obtenu avec une impulsion de

mon archive source « son1 » puis un temps de retard de 3ms, la

fréquence du lfo variant de -1 à 1 et le taux de réinjection ou feedback à 100%

Pour illustrer la puissance génératrice

du taux de réinjection voici un son de 24 secondes obtenu avec une impulsion de

mon archive source « son1 » puis un temps de retard de 3ms, la

fréquence du lfo variant de -1 à 1 et le taux de réinjection ou feedback à 100%

Les paramètres d’analyse ont changé dans

la résolution fréquentielle : taille de l’analyse FFT 1024 et la

représentation graphique allant jusqu’au 22KHz, tous les restes sont conservés

comme dans les analyses précédents.

Les paramètres d’analyse ont changé dans

la résolution fréquentielle : taille de l’analyse FFT 1024 et la

représentation graphique allant jusqu’au 22KHz, tous les restes sont conservés

comme dans les analyses précédents.

Trois remarques dans ce son. Le mouvement des composantes spectrales

en forme de triangle, dû à la fréquence de modulation du temps du retard d’abord

dent de scie puis rampe, produit par l’inversion de phase quand la fréquence

traverse des côtés négatifs vers les positifs. Deuxième remarque, la

réapparition de l’attaque déclencheur qui se nourrit en composantes avec la

réinjection. Et troisième remarque, le creux spectral quand la fréquence de

modulation approche le zéro.

Les traitements étudiés jusqu’ici ont lieu

dans le domaine temporel, manipulant les échantillons dans son amplitude pour

les modulations ou bien dans le temps comme dans les lignes à retards et

filtres. L’analyse de Fourier, permet de traduire les signaux audio dans le

domaine fréquentiel et de réaliser les traitements directement sur le spectre.

Mathématiquement,

la transformée de Fourier est déniée sur des fonctions continues de −∞ à

+∞, dans le cas de signaux numériques on doit utiliser un type de transformée

de Fourier appelée « discrète » sur un intervalle de temps fini correspondant

à N échantillons.

Avant de continuer

dans les implémentations, je voudrais réviser quelques définitions que l’on

trouve souvent dans le vocabulaire technique quand il s’agit d’Analyse de

Fourier :

Fenêtrage : le fenêtrage est utilisé dès que l'on s'intéresse à un

signal de longueur volontairement limité. En effet, un signal réel ne peut

qu'avoir une durée limitée dans le temps ; de plus, un calcul ne peut se faire

que sur un nombre de points fini. Pour observer un signal sur une durée finie,

on le multiplie par une fonction fenêtre d'observation (également appelée

fenêtre de pondération). Parmi les fonctions les plus courantes, il y a la

fenêtre rectangulaire, de

Hanning, de Hamming, et de Blackman.

La Transformée de

Fourier (TF) du signal analysé est convoluée avec la TF de la fenêtre

; dans l'idéal, pour ne pas biaiser le spectre initial, il faudra que l'allure

de la fenêtre spectrale soit une fonction de Dirac. Or, le signal temporel ayant un spectre en fonction de dirac est

un signal constant infini, ce qui est impossible en pratique. Les allures

spectrales des fenêtres de pondérations présentent une succession de lobes :

pour se rapprocher d'une fonction de Dirac, il faut que le lobe principal soit

le plus étroit possible, tandis que les lobes secondaires doivent être les plus

faibles possible. Plus le lobe principal d'une fenêtre aura tendance à être

étroit, plus ses lobes secondaires seront importants. Il y a donc toujours un

compromis à faire entre largeur du lobe principal et importance des lobes

secondaires.

Plus la fenêtre

choisie aura une grande durée temporelle, plus elle sera étroite dans le

domaine fréquentiel. Le taux de recouvrement des fenêtres « overlap » permet de lisser le

signal à l'analyse et à la résynthèse.

Taille de l’analyse : ce facteur détermine la précision fréquentielle de l'analyse, et

s’exprime en nombre d’échantillons. La transformée de Fourier discrète faite en

appliquant directement son équation mathématique nécessite N multiplications pour

calculer un coefficient de Fourier ak, comme il y en a également N le

temps de calcul de la transformée de Fourier serait de N2

multiplications.

C’est donc une opération

lourde en calcul, heureusement Cooleyet Tukey

ont remarqué que si N est une puissance de 2 on peut faire le calcul beaucoup plus

vite. En effet en utilisant les symétries paires impaires, il est possible de réduire

le nombre d’opérations à N.log2N. Si nous voulons faire une transformée de Fourier

sur 1024 points (210) on passe de 106 à 104 opérations

soit un gain d’un facteur 100.

Si on effectue une

analyse de Fourier sur une fenêtre de 1024 échantillons extraits du signal, on

obtiendra une analyse en 1024 points ou bins

ou tranches ou paniers de fréquences. On comprend donc que plus la fenêtre est

large, plus on a de points dans l’analyse spectrale et plus elle est précise au

niveau fréquentielle. Par contre, l'information étant estimée sur toute la

longueur de l'analyse, les évènements très rapides, comme les attaques, seront adoucis

par la moyenne effectuée sur plusieurs échantillons. Le compromis est inévitable.

Par exemple, si on

utilise une fenêtre de 1024 échantillons, on obtient un spectre de 1024 points.

Ces 1024 points sont répartis de 0 à 44100 Hz, donc, en réalité, on n’a que 512

points de 0 à 22050 Hz (fréquences positives). Les points sont espacés de

44100/1024 = 43 Hz.

Imaginaire et Réel : la transformée de Fourier d’un signal réel est un signal complexe, c’est-à-dire un signal à deux

dimensions car chaque composante est définie par deux paramètres: son amplitude

et sa phase.

L'ensemble des

nombres complexes est l'ensemble des nombres de la forme :

Z = a + bi où a et b sont des réels quelconques

et i un nouveau nombre tel que

i ²= -1.

Le nombre a est

appelé partie réelle de z et noté parfois Re(z).

Le nombre b est

appelé partie imaginaire de z et noté parfois Im(z).

La forme z = a + bi est appelée forme algébrique de z. On peut aussi représenter un

nombre complexe suivant ses coordonnées polaires. Les coordonnées sont alors

l’amplitude (r) et l’angle (a) (phase). Sa magnitude ou valeur absolue étant la

distance à l’origine dans le plan complexe.

Z = reia Avec

: eia = cos a + i sin

a

Dans SuperCollider

plusieurs UGens supportent des traitements basés sur le FFT, les plus basiques

étant FFT et IFFT, ces deux classes permettent de passer du domaine temporel au

domaine fréquentiel et vice-versa. Le contenu spectral du signal est placé dans

un « buffer local » dont la

taille qui est une puissance de deux correspondra à la taille de l’analyse.

Dans ce buffer on stocke les données dans l’ordre suivant : DC offset,

nyquist, real 1f, imag 1f, real 2f, imag 2f... real (N-1)f, imag (N-1)f, où f

est la fréquence relative à la taille de la fenêtre, et N est la taille de la

fenêtre sur 2.Le taux de recouvrement des fenêtres est par defaut de 50%, le

type de fenêtre est « Hanning »

Parmi toutes les

opérations possibles sur l’information spectrale, SuperCollider propose dans sa

distribution publique les implémentations suivantes

FFT Fast Fourier Transform

IFFT

Inverse Fast Fourier Transform

PV_Add somme de coefficients complexes

PV_BinScramble brouillage

de bins (tranches, paniers de fréquences)

PV_BinShift déplacement

et élargissement de positions de bins

PV_BinWipe combinaison de bas et

hauts bins sur deux entrées

PV_BrickWall zéro bins

PV_ConformalMap attaque dans le plan complexe

PV_Copy copier

un FFT buffer

PV_CopyPhase copier

magnitudes et phases

PV_Diffuser aléatoire

déplacements de phase

PV_LocalMax pas bins lesquels ont un

maximum local

PV_MagAbove pas

bins sur un limite

PV_MagBelow pas bins en dessous un limite

PV_MagClip clip bins sur un limite

PV_MagFreeze geler

les magnitudes

PV_MagMul multiplier les

magnitudes

PV_MagDiv division de

magnitudes

PV_MagNoise multiplication de magnitudes avec bruit

PV_MagShift déplacement et

élargissement de magnitudes de bins

PV_MagSmear appliquer une moyenne aux magnitudes pour tous

les bins

PV_MagSquared

carré des magnitudes

PV_Max maximum magnitude

PV_Min minimum magnitude

PV_Mul multiplication de complexes

PV_PhaseShift déplacement de phase pour tous les bins

PV_PhaseShift270 déplacer la phase de 270

dégrées

PV_PhaseShift90 déplacer la

phase de 90 dégrées

PV_RandComb pas

aléatoirement de bins

PV_RandWipe crossfade dans un ordre aléatoire des bins

PV_RectComb faire distances ou trous dans le spectre

UnpackFFT,

PackFFT, Unpack1FFT "unpacking"

components

Une transformation

conforme, (conformal map), également

appelée une carte « mapping » conforme,

transformation de

préservation de l'angle, ou carte

biholomorphe, est une transformation qui préserve la magnitude des angles

locaux. Une fonction analytique est conforme en tout point où elle a une dérivé

non nul. Inversement, toute transformation conforme d'une variable complexe qui

a des dérivées partielles continues est analytique.

Ce synthétiseur applique

la transformée conforme aux bins issus de le FFT chainA avec des

coefficients réels et imaginaires donnés comme argument à l’Ugen. Cette

transformation spectrale au signal d’entrée, donne comme résultat un signal

fourni de « perturbations » sonores remplissant le haut du spectre,

perceptivement je dirai que il s’agit d’un effet de clochettes qui se ajoutent

au son du départ.

SynthDef(\complexattack,{|inBus=26,gate=1,wet=1,vol=1,real=0.5,img=0.5,

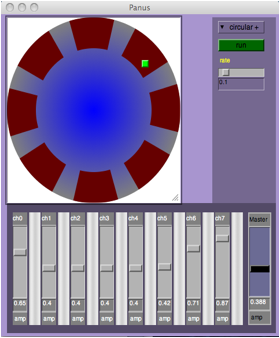

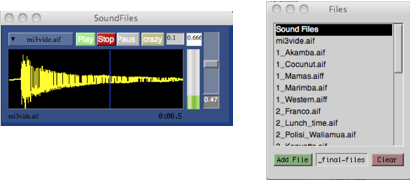

out1=20,out2=21,out3=22,out4=23,out5=24,out6=25,out7=26,out8=27,